.Light computes any desired linear transform without a digital processor

http://blog.naver.com/mssoms

http://jl0620.blogspot.com

http://jk0620.tripod.com

https://www.facebook.com/junggoo.lee.9

.Light computes any desired linear transform without a digital processor

Light는 디지털 프로세서 없이 원하는 선형 변환을 계산합니다

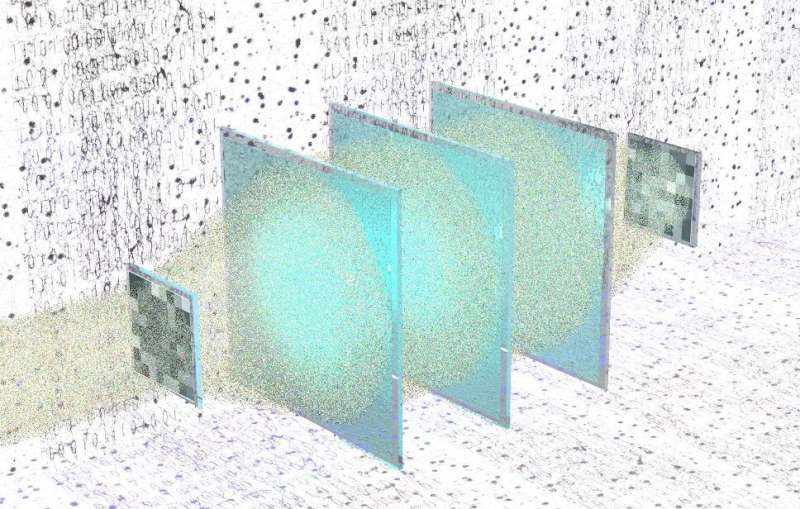

에 의한 기술 발전을위한 UCLA 공학 연구소 회절 표면을 사용한 임의 선형 변환의 전광학 합성 크레딧: Ozcan 연구소, UCLA SEPTEMBER 24, 2021

푸리에 변환과 같은 다양한 형태의 선형 변환은 다양한 응용 프로그램에서 정보 처리에 널리 사용됩니다. 이러한 변환은 일반적으로 전자 프로세서를 사용하여 디지털 영역에서 구현되며 사용되는 전자 칩의 용량에 따라 계산 속도가 제한되어 데이터 및 이미지 크기가 커질수록 병목 현상이 발생합니다. 이 문제의 해결책은 디지털 프로세서를 광학 프로세서로 교체하고 빛을 사용하여 정보를 처리하는 것입니다.

-Light: Science & Applications에 게재된 새로운 논문 에서 미국 로스앤젤레스 캘리포니아 대학교(UCLA) 전기 및 컴퓨터 공학부의 Aydogan Ozcan 교수와 동료들이 이끄는 광학 엔지니어 팀이 다음을 개발했습니다. 임의의 선형 변환의 전광학 계산을 위한 딥 러닝 기반 설계 방법 . 이 전광 프로세서광파를 조작할 때 공간적으로 설계된 회절 표면을 사용하고 빛이 일련의 회절 표면을 통과할 때 원하는 선형 변환을 계산합니다. 이러한 방식으로 원하는 선형 변환의 계산은 이러한 회절 표면을 통한 입력 광의 투과와 함께 광 전파 속도로 완료됩니다.

그 계산 속도뿐만 아니라, 이러한 모든 광학 프로세서는 조명을 제외한 모든 컴퓨팅 전력을 소모하지 않는 광 그것을 수동 및 높은 처리량을 계산 시스템을 제작. UCLA 팀이 수행한 분석 에 따르면 이러한 전광 회절 프로세서의 딥 러닝 기반 설계 는 입력 평면과 출력 평면 사이의 임의의 선형 변환을 정확하게 합성할 수 있으며 결과 광학 변환의 정확도와 회절 효율을 크게 합성할 수 있습니다.

회절 표면의 수가 증가함에 따라 개선되어 더 깊은 회절 프로세서가 컴퓨팅 기능에서 더 강력하다는 것을 보여줍니다. 이 방법의 성공은 예를 들어 무작위로 생성된 위상 및 진폭 변환, 푸리에 변환, 이미지 순열 및 필터링 작업을 포함한 광범위한 선형 변환을 수행함으로써 입증되었습니다. 이 컴퓨팅 프레임워크는 임의의 복소수 선형 변환을 보편적으로 수행하기 위해 공간적으로 설계된 회절 표면을 사용하여 전광 프로세서를 설계하기 위해 전자기 스펙트럼의 모든 부분에 광범위하게 적용될 수 있습니다.

또한 입력 평면과 출력 평면 사이에서 원하는 계산 작업을 실행하기 위해 전광 정보 처리 네트워크를 형성하는 데 사용할 수 있으며, 디지털 프로세서에 대한 수동적이고 전원이 필요 없는 대안을 제공합니다.

추가 탐색 전광 회절 신경망은 광대역 빛을 처리합니다. 추가 정보: Onur Kulce et al, 회절 표면을 사용한 임의의 선형 변환의 전광학 합성, 빛: 과학 및 응용 (2021). DOI: 10.1038/s41377-021-00623-5 저널 정보: 빛: 과학 및 응용 에 의해 제공 기술 진흥 UCLA 공학 연구소

https://phys.org/news/2021-09-desired-linear-digital-processor.html

===============

메모 2109270614 나의 사고실험 oms 스토리텔링

빛의 회절현상은 파동이 입자로서는 도저히 갈 수 없는 영역에 휘어져 도달하는 현상이 회절이다. 빛의 파동성이 입자성보다 더 세밀하다는 뜻일 수 있다.

oms=2 단위가 1+1=2, 1-1=0 일 수 있음으로 하여 샘플2. oss의 베이스1.x2의 2^43 베이스2.를 구현할 수 있었다. 여기서 1+1=2은 입자성, 1-1=0 파동성을 나타내어 빛의 파동성이 구조체 해법의 zerosum 현상을 나타내는 oss의 닮은꼴 직계인듯 보인다. 허허. 그만큼 회절현상처럼 세세하고 다양하며 광범위하게 적용된다는 뜻일 수 있다.

만약에 우주의 빛은 파동성으로 설명함에 있어, 은하 내부를 돌아돌아 온 빛들을 양자 수퍼컴퓨팅으로 전부 계산해 보겠다? 말이 안된다. 그래서 샘플1.oms와 같은 전력소모가 전혀 없는 인간의 뉴런 뇌공학적인 '지능으로 계산해야 한다'거여, 허허.

>>>>???

우주의 중력렌즈들, oms 팽대부 힉스렌즈? 등의 빅테이타를 일일리 '양자 수퍼컴퓨팅으로 처리한다'는 게 말이 전혀 안돼여. 왜 그쪽은 비웃나? 황당한가? 꺼져! Sample 1. 12th oms 하나만 있으면 빛의 세상(all-optical processor)은 다 밝혀지는거여. 빛은 공간적으로 격자 설계된 회절 표면을 사용하고 빛이 일련의 회절 표면을 통과할 때 원하는 선형 변환1xn 값을 계산하면 끝이다. 샘플1. oms을 통과한 빛의 회절은 1x6=6, 6^∞의 값을 가진다. 허허.

Sample 1. 12th oms

b0acfd 0000e0

000ac0 f00bde

0c0fab 000e0d

e00d0c 0b0fa0

f000e0 b0dac0

d0f000 cae0b0

0b000f 0ead0c

0deb00 ac000f

ced0ba 00f000

a0b00e 0dc0f0

0ace00 df000b

0f00d0 e0bc0a

sample 2/oss

zxdxybzyz

zxdzxezxz

xxbyyxzzx

zybzzfxzy

cadccbcdc

cdbdcbdbb

xzezxdyyx

zxezybzyy

bddbcbdca

-Light: In a new paper published in Science & Applications, a team of optical engineers led by Professor Aydogan Ozcan and colleagues in the Department of Electrical and Computer Engineering at the University of California, Los Angeles (UCLA), USA, has developed: A deep learning-based design method for all-optical computation of arbitrary linear transformations. This all-optical processor uses a spatially designed diffractive surface when manipulating light waves and calculates the desired linear transformation as light passes through a series of diffractive surfaces. In this way, the calculation of the desired linear transformation is done with the transmission of the input light through these diffractive surfaces and the speed of light propagation.

- When manipulating an all-optical processor, it uses a spatially designed diffractive surface and calculates the desired linear transformation as light passes through a series of diffractive surfaces. In this way, the calculation of the desired linear transformation is done with the transmission of the input light through these diffractive surfaces and the speed of light propagation.

Material 1.

Diffraction is one of the representative wave phenomena. It is called 'edoli' in pure Korean, and when sound waves, radio waves, or light waves pass through obstacles or narrow gaps, the waves propagate to the back (shadow part).

Diffraction phenomena as interference phenomena include 1st and 2nd-order diffraction phenomena that occur when visible light is reflected by a diffraction grating, when X-rays are reflected by a solid crystal, and when a wavelength passes through a narrow gap.

Diffraction is usually referred to as a variety of phenomena caused by striking obstacles. For example, refracting light waves, acoustic impedance, acoustic waves, etc. These are related to diffraction phenomena. Diffraction occurs in all waves. It can be seen in places such as sound waves, water waves, magnetic waves, light, X-rays, and radio waves.

If there is an obstacle with a gap in the path of the particle, the particle travels in a straight line through the gap. On the other hand, in the case of a wave, it goes back not only on a straight path through the gap, but also within a certain range around it. Diffraction is a phenomenon in which a wave bends to reach a region that a particle cannot possibly go to. Diffraction can be easily observed by passing a wave wave through a narrow gap.

The degree of diffraction is affected by the size and wavelength of the gap. The longer the wavelength compared to the size of the gap, the more diffraction occurs. In other words, when the wavelength is constant, diffraction occurs more easily as the size of the gap is smaller, and when the wave with a straight wavefront passes through the narrow gap, it spreads in a semicircle shape. An example of light is represented by nλ=2dsinθ according to Bragg's law.

=================

memo 2109270614 my thought experiment oms storytelling

Diffraction of light is a phenomenon in which a wave bends to reach a region that a particle cannot possibly go to. This could mean that the wave nature of light is more fine-grained than the particle nature.

Sample2, given that oms=2 units can be 1+1=2, 1-1=0. I was able to implement 2^43 base2. of oss base 1.x2. Here, 1+1=2 represents particle nature and 1-1=0 wave nature, so the wave nature of light seems to be a direct descendant of the resemblance of oss, which represents the zerosum phenomenon of the structure solution. haha. It can mean that it is applied in a detailed, diverse and broad manner like diffraction phenomena.

If light in the universe is described as a wave star, how about calculating all of the light returning from inside the galaxy by quantum supercomputing? nonsense. So, human neuron, which consumes no power like sample 1.oms, is brain engineering 'should be calculated with intelligence', heh heh.

>>>>???

Cosmic gravitational lenses, oms bulge Higgs lens? It doesn't make any sense to 'process big data with quantum supercomputing' every day. Why are you laughing at him? Is it absurd? go away! Sample 1. With just one 12th oms, the whole world of light (all-optical processor) is illuminated. Light uses a spatially grating designed diffractive surface and computes the desired linear transformation 1xn value as the light passes through a series of diffractive surfaces. Sample 1. The diffraction of light passing through oms has values of 1x6=6, 6^∞. haha.

Sample 1. 12th oms

b0acfd 0000e0

000ac0 f00bde

0c0fab 000e0d

e00d0c 0b0fa0

f000e0 b0dac0

d0f000 cae0b0

0b000f 0ead0c

0deb00 ac000f

ced0ba 00f000

a0b00e 0dc0f0

0ace00 df000b

0f00d0 e0bc0a

sample 2/oss

zxdxybzyz

zxdzxezxz

xxbyyxzzx

zybzzfxzy

cadccbcdc

cdbdcbdbb

xzezxdyyx

zxezybzyy

bddbcbdca

.Computer Science: How Quickly Do Algorithms Improve?

컴퓨터 과학: 알고리즘은 얼마나 빨리 향상됩니까?

주제:연산컴퓨터 과학CSAIL와 함께 작성자: RACHEL GORDON, MIT CSAIL 2021년 9월 25일 컴퓨터 코드 속도 알고리즘 개념 SEPTEMBER 25, 2021

-MIT 과학자들은 알고리즘이 컴퓨팅 개선의 가장 중요한 원천 중 하나라는 최초의 체계적이고 정량적인 증거를 제시합니다. MIT 과학자들은 광범위한 예에서 알고리즘이 얼마나 빠르게 개선되고 있는지 보여주며 컴퓨팅 발전에서 알고리즘의 중요성을 보여줍니다. 알고리즘은 컴퓨터의 부모와 같습니다. 그들은 컴퓨터에게 정보를 이해하는 방법을 알려준 다음 정보에서 유용한 것을 만들 수 있습니다. 알고리즘이 더 효율적일수록 컴퓨터가 수행해야 하는 작업이 줄어듭니다.

컴퓨팅 하드웨어의 모든 기술적 진보와 무어의 법칙의 많은 논쟁거리가 있는 수명에 대해 컴퓨터 성능은 그림의 한 면에 불과합니다. 배후에서 두 번째 추세가 발생하고 있습니다. 알고리즘이 개선되고 있으므로 더 적은 컴퓨팅 성능이 필요합니다. 알고리즘 효율성이 주목을 덜 받을 수 있지만 신뢰할 수 있는 검색 엔진이 갑자기 10분의 1 속도가 되거나 큰 데이터 세트를 통해 이동하는 것이 슬러지를 헤쳐나가는 것처럼 느껴진다면 분명히 알 수 있습니다. 이로 인해 MIT 컴퓨터 과학 및 인공 지능 연구소(CSAIL) 과학자들은 다음과 같이 질문했습니다. 알고리즘은 얼마나 빨리 개선됩니까? 이 질문에 대한 기존 데이터는 더 넓은 범위를 대표하는 것으로 가정된 특정 알고리즘의 사례 연구로 구성된 대체로 일화적이었습니다. 이러한 증거 부족에 직면하여 팀은 알고리즘이 개선된 시기의 역사를 추적하기 위해 57개의 교과서와 1,110개 이상의 연구 논문에서 데이터를 분석하기 시작했습니다.

일부 연구 논문은 새로운 알고리즘이 얼마나 좋은지 직접 보고했으며, 다른 논문은 기본 세부 사항을 설명하는 알고리즘의 축약형 버전인 "의사 코드"를 사용하여 저자가 재구성해야 하는 경우도 있습니다. 팀은 전체적으로 113개의 "알고리즘 패밀리"를 조사했습니다. 이 알고리즘은 컴퓨터 과학 교과서에서 가장 중요하다고 강조한 동일한 문제를 해결하는 알고리즘 세트입니다. 113개 각각에 대해 팀은 이력을 재구성하여 문제에 대해 새로운 알고리즘이 제안될 때마다 추적하고 더 효율적인 알고리즘을 특별히 기록했습니다. 1940년대부터 지금까지 수십 년으로 구분된 성능 범위에서 팀은 제품군당 평균 8개의 알고리즘을 찾았으며 그 중 몇 개는 효율성이 향상되었습니다. 이 수집된 지식 데이터베이스를 공유하기 위해 팀은 Algorithm-Wiki.org도 만들었습니다.

과학자들은 알고리즘에서 가장 많이 분석된 기능, 즉 문제 해결을 보장할 수 있는 속도(컴퓨터에서 "최악의 경우 시간 복잡성")에 초점을 맞춰 이러한 제품군이 얼마나 빨리 개선되었는지 차트로 작성했습니다. 등장한 것은 엄청난 가변성뿐 아니라 컴퓨터 과학에 있어 알고리즘 개선이 어떻게 변모했는지에 대한 중요한 통찰력이었습니다. 대규모 컴퓨팅 문제의 경우 알고리즘 제품군의 43%가 무어의 법칙에서 얻은 이득과 같거나 더 큰 전년 대비 개선을 보였습니다. 문제의 14%에서 알고리즘의 성능 향상이 하드웨어 개선으로 인한 성능 향상을 훨씬 앞질렀습니다. 알고리즘 개선의 이점은 빅데이터 문제에서 특히 크므로 이러한 발전의 중요성은 최근 수십 년 동안 증가했습니다.

저자가 관찰한 가장 큰 변화는 알고리즘 패밀리가 지수에서 다항식 복잡성으로 전환되었을 때였습니다. 지수 문제를 푸는 데 드는 노력의 양은 사람이 자물쇠의 조합을 추측하려고 하는 것과 같습니다. 10자리 다이얼 하나만 있으면 작업이 쉽습니다. 자전거 자물쇠와 같은 4개의 다이얼을 사용하면 아무도 당신의 자전거를 훔치지 못할 만큼 어렵지만 모든 조합을 시도할 수 있다는 것은 상상할 수 있습니다. 50이면 거의 불가능합니다. 너무 많은 단계가 필요합니다.

기하급수적인 복잡성을 갖는 문제는 컴퓨터의 경우와 같습니다. 문제가 커질수록 컴퓨터가 처리하는 능력을 빠르게 능가합니다. 다항식 알고리즘을 찾는 것은 종종 그것을 해결하여 하드웨어 개선으로는 불가능한 방식으로 문제를 해결할 수 있습니다. 무어의 법칙이 끝나간다는 소문이 전 세계적으로 빠르게 퍼지면서 연구원들은 컴퓨팅 사용자가 성능 향상을 위해 알고리즘과 같은 영역으로 눈을 돌릴 필요성이 점점 더 커질 것이라고 말합니다. 팀은 이번 발견을 통해 역사적으로 알고리즘의 이점이 엄청났기 때문에 잠재력이 있음을 확인했다고 말합니다. 그러나 하드웨어가 아닌 알고리즘에서 이득이 나온다면 다르게 보일 것입니다.

무어의 법칙에 따른 하드웨어 개선은 시간이 지남에 따라 순조롭게 이루어지며 알고리즘의 경우 일반적으로 크지만 드물게 발생하는 단계적으로 이득이 발생합니다. CSAIL과 Sloan School of Management의 MIT 연구원이자 새 논문의 수석 저자인 Neil Thompson은 "이번 논문은 광범위한 예제에서 알고리즘이 얼마나 빠르게 개선되고 있는지를 보여주는 첫 번째 논문입니다."라고 말했습니다. “분석을 통해 알고리즘이 개선된 후 동일한 양의 컴퓨팅 성능을 사용하여 얼마나 더 많은 작업을 수행할 수 있는지 말할 수 있었습니다.

-문제가 수십억 또는 수조 개의 데이터 포인트로 증가함에 따라 하드웨어 개선보다 알고리즘 개선이 훨씬 더 중요해졌습니다. 컴퓨팅의 환경 발자국이 점점 더 우려되는 시대에 이것은 단점 없이 비즈니스와 다른 조직을 개선하는 방법입니다.”

참조: "알고리즘은 얼마나 빨리 향상됩니까?" Yash Sherry 및 Neil C. Thompson 작성, 2021년 9월 20일 , IEEE Proceedings . DOI: 10.1109/JPROC.2021.3107219 Thompson은 MIT 방문 학생 Yash Sherry와 함께 논문을 작성했습니다. 이 논문은 IEEE Proceedings에 게재되었습니다 . 이 작업은 Tides 재단과 MIT 디지털 경제 이니셔티브의 자금 지원을 받았습니다.

https://scitechdaily.com/computer-science-how-quickly-do-algorithms-improve/

===================

메모 210926`005 나의 사고실험 oms 스토리텔링

오늘날 컴퓨팅의 의존하면서 빅데이타 시대임을 말하고 인공지능이 알아서 처리하는 시대이다. 모든 데이타가 컴퓨팅이면 저절로 분석이 될까? 우주시대에 사는 우리에게 대단한 착각들이다. 알고리즘으 개선없이 진화하는 컴퓨터가 빠르고 좋은 해답을 도출해낼 수 없다. 그 알고리즘은 여전히 인간의 두뇌에서 제공되고 있다.

샘플2.oss에서 도출하는 마방진의 2^43의 갯수는 컴퓨팅으로 구현된 게 아니다. 나의 '구조체 해법'이란 알고리즘에 의해 나타났으며, 베이스를 몇십개만 돌려도 양자 수퍼컴퓨팅을 천억 광년을 돌려야 나올 수 있는 답들이다. 나는 그 알고리즘으로 단 1초 이내에 그 숫자더미 마방진을 구현할 수 있다. 허허.

지금도 여전히 컴퓨팅에서 MS GOOGLE APPLE IBM 소프트웨어가 하드웨어를 지배력을 확장하고 있다. 그 소프트웨어들도 인간의 창의적인 알고리즘을 기반으로 진화되어야, 더 나은 수퍼급 프로그램이 된다.

하지만, 인간의 지적인 두뇌의 특별함에는 여전히 그 능력들은 지극히 미비하다. 인간이 광범위한 통찰력을 가지고 우주의식을 가지며 암흑물질(힉스입자), 암흑에너지(MACHO)를 샘플1. oms에서 빅뱅사건과 우주진화를 정의할 때, 수퍼 컴퓨팅은 도대체 뭘 계산하고들 있나? 허허.

sample1.oms(standard)

b0acfd 0000e0

000ac0 f00bde

0c0fab 000e0d

e00d0c 0b0fa0

f000e0 b0dac0

d0f000 cae0b0

0b000f 0ead0c

0deb00 ac000f

ced0ba 00f000

a0b00e 0dc0f0

0ace00 df000b

0f00d0 e0bc0a

sample 2/oss

zxdxybzyz

zxdzxezxz

xxbyyxzzx

zybzzfxzy

cadccbcdc

cdbdcbdbb

xzezxdyyx

zxezybzyy

bddbcbdca

- As the problem grows to billions or trillions of data points, algorithm improvements become far more important than hardware improvements. In an era where computing's environmental footprint is increasingly concerned, it's a way to improve business and other organizations without downsides.”

=====================

Memo 210926`005 My Thought Experiment oms Storytelling

Today is the era of big data relying on computing and artificial intelligence takes care of it. If all data is computing, can it be analyzed automatically? These are great illusions for us living in the space age. Without algorithmic improvements, an evolving computer cannot come up with fast and good answers. The algorithm is still being served by the human brain.

The number of 2^43 magic squares derived from sample 2.oss is not implemented by computing. My 'structural solution' appeared by an algorithm, and these are the answers that can be obtained only by running a quantum supercomputing 100 billion light-years with just a few dozen bases. I can implement that dummy magic square in just 1 second with that algorithm. haha.

Even today, in computing, MS GOOGLE APPLE IBM software continues to extend its dominance in hardware. Those software must also evolve based on human creative algorithms to become better super-level programs.

However, the abilities of the human intelligent brain are still very insignificant. Humans have broad insight and cosmic consciousness, sample dark matter (Higgs particle) and dark energy (MACHO)1. When oms define the big bang event and cosmic evolution, what is supercomputing calculating? haha.

sample1.oms(standard)

b0acfd 0000e0

000ac0 f00bde

0c0fab 000e0d

e00d0c 0b0fa0

f000e0 b0dac0

d0f000 cae0b0

0b000f 0ead0c

0deb00 ac000f

ced0ba 00f000

a0b00e 0dc0f0

0ace00 df000b

0f00d0 e0bc0a

sample 2/oss

zxdxybzyz

zxdzxezxz

xxbyyxzzx

zybzzfxzy

cadccbcdc

cdbdcbdbb

xzezxdyyx

zxezybzyy

bddbcbdca

댓글